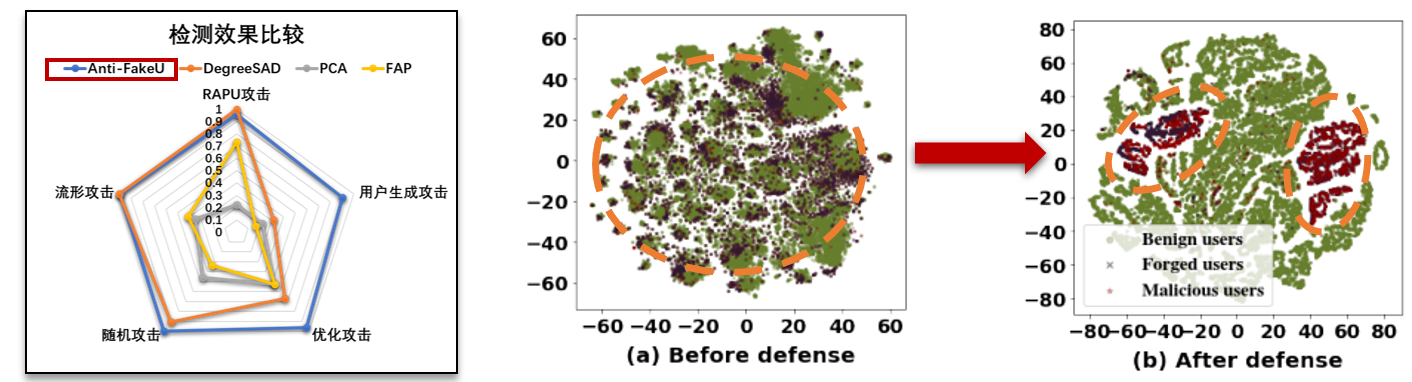

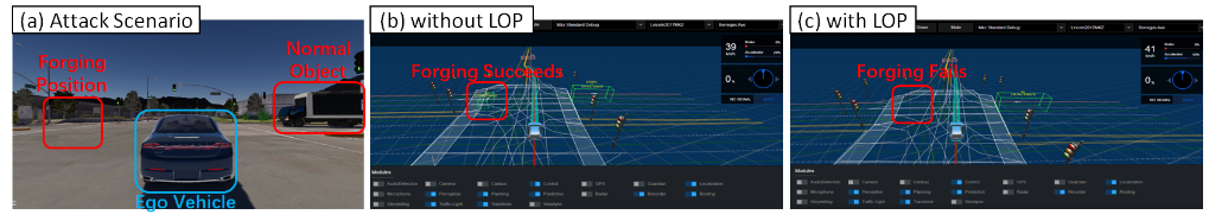

预训练模型、外包标注数据、分布式训练在AI产业生态中十分重要,而各大第三方模型仓库普遍缺少有效的监管措施,导致系统存在对抗攻击/模型后门隐患。

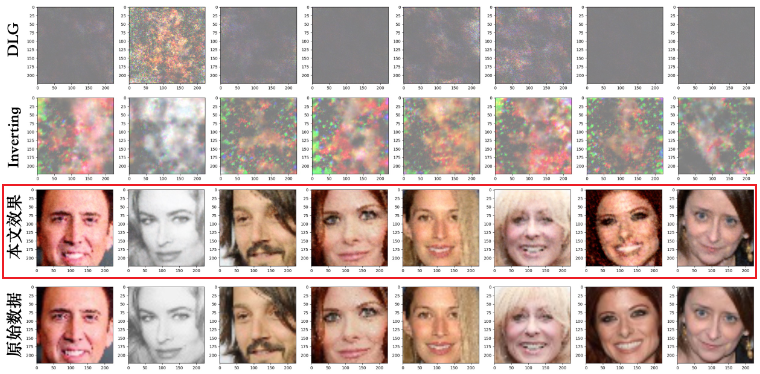

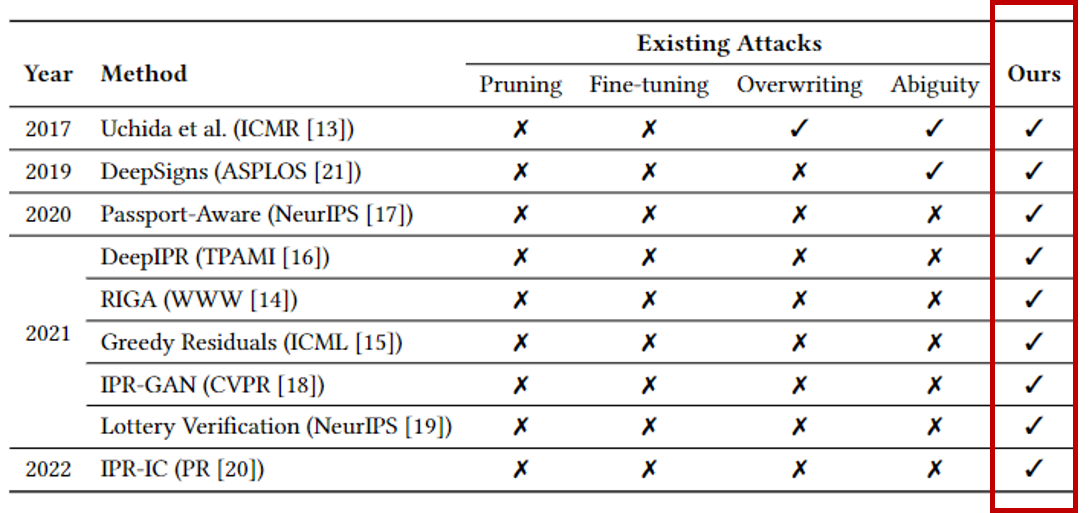

面对金钱诱惑,攻击者通过各种手段从端侧和云端窃取模型,形成版权侵害;开放环境下的AI生态正面临中间计算结果泄露用户隐私数据严峻挑战。

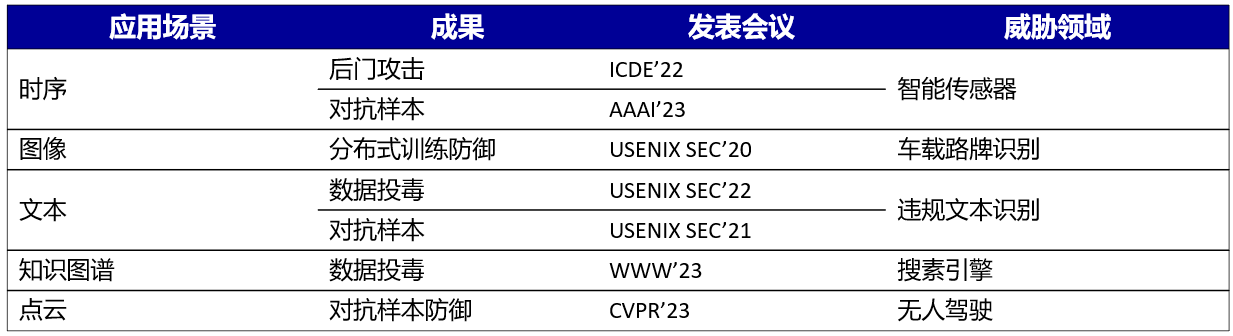

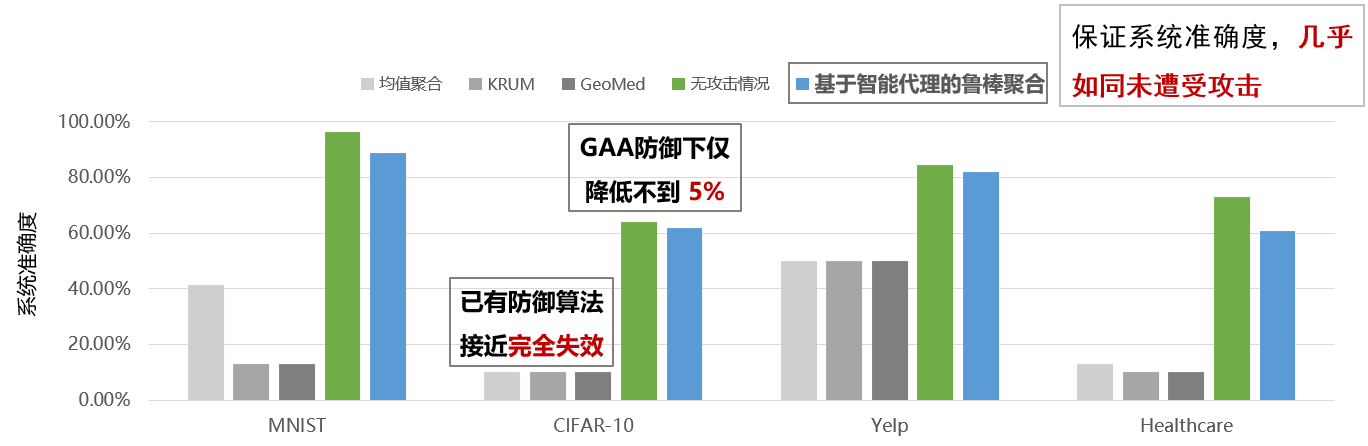

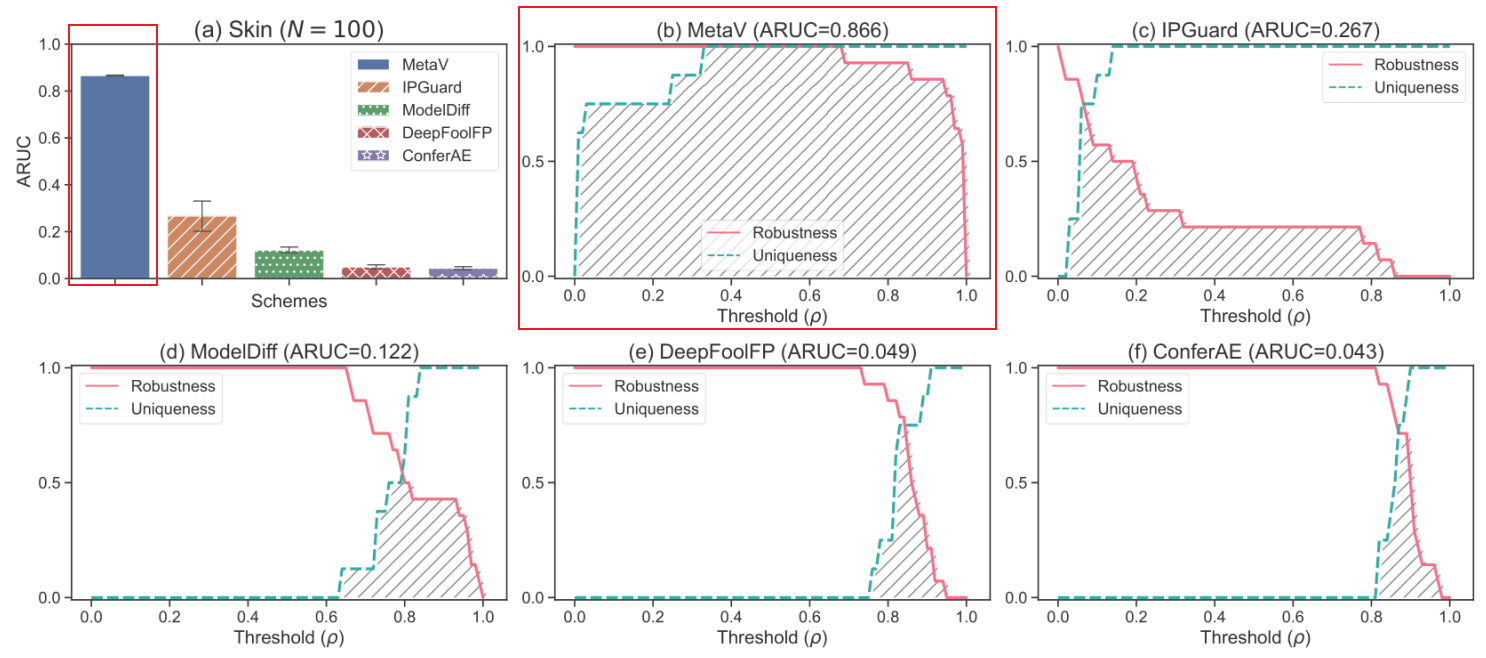

团队致力于运用前沿AI技术赋能网络空间安全,建设攻防自动化和威胁智能感知能力。